Seit Oktober 2018 unterstützt die ständige Wissenschaftliche Arbeitsgruppe den Nationalen Cyber-Sicherheitsrat. Sie berät aus Perspektive der Forschung zu Entwicklungen und Herausforderungen im Hinblick auf eine sichere, vertrauenswürdige und nachhaltige Digitalisierung.

Der 2011 eingerichtete Nationale Cyber-Sicherheitsrat (NCSR) gestaltet unter dem Vorsitz des Beauftragten der Bundesregierung für Informationstechnik (BfIT), Staatssekretär Dr. Markus Richter vom Bundesministerium des Innern und für Heimat (BMI), die Zusammenarbeit im Bereich Cyber-Sicherheit innerhalb der Bundesregierung sowie zwischen Staat und Wirtschaft.

Der Nationale Cyber-Sicherheitsrat fungiert dabei als strategischer Ratgeber der Bundesregierung und bringt hochrangige Vertreter von Bund, Ländern sowie aus der Wirtschaft an einen Tisch. Er bietet somit ein geeignetes Format, um die für Deutschland im Bereich Cyber-Sicherheit wesentlichen strategischen Themen übergreifend voranzutreiben.

Seit Oktober 2018 unterstützt die ständige Wissenschaftliche Arbeitsgruppe – unter geteilter Leitung von BMI, Referat „Internationale Cybersicherheit und Cybersicherheitsforschung“ und BMFTR, Referat „Vernetzung und Sicherheit digitaler Systeme“ – den Nationalen Cyber-Sicherheitsrat. Sie berät aus Perspektive der Forschung zu Entwicklungen und Herausforderungen im Hinblick auf eine sichere, vertrauenswürdige und nachhaltige Digitalisierung.

Die Wissenschaftliche Arbeitsgruppe erstellt in regelmäßigen Abständen Impulspapiere, die ausgewählte Themen zur Cybersicherheit aus einer Forschungsperspektive beleuchten. Die Papiere geben die Meinung der Autorinnen und Autoren wieder und nicht notwendigerweise die Meinung der Bundesregierung oder der Bundesministerien.

Vom Einsatz generativer Künstlicher Intelligenz (KI) werden beträchtliche wirtschaftliche Impulse erwartet. Auch für das Gebiet der Cybersicherheit verspricht der kontrollierte Einsatz generativer KI erhebliche Mehrwerte und Chancen. Gleichzeitig gehen mit ihrem Einsatz aber auch neue Risiken einher.

Das Impulspapier „Generative Künstliche Intelligenz und ihre Auswirkungen auf die Cybersicherheit“ beleuchtet beide Facetten generativer KI in der Cybersicherheit und formuliert Empfehlungen, die sowohl dringende Forschungsfragen adressieren als auch auf Umsetzungsthemen eingehen. Dazu gehören Vorschläge zur Entwicklung und Erprobung von Testverfahren sowie zur Etablierung von vertrauenswürdigen Plattformen, die den sicheren Betrieb KI-basierter Ökosysteme ermöglichen.

Von dem Einsatz generativer Künstlicher Intelligenz (KI) werden beträchtliche wirtschaftliche Impulse erwartet. So geht eine McKinsey-Studie von einem weltweiten, wirtschaftlichen Wachstumspotenzial von jährlich zwischen ca. 2 und 4 Billionen US-Dollar aus. Auch für das Gebiet der Cybersicherheit verspricht der kontrollierte Einsatz generativer KI erhebliche Mehrwerte und Chancen. Gleichzeitig gehen mit ihrem Einsatz aber auch erhebliche neue Risiken für die Cybersicherheit einher. So kann die Nutzung generativer KI als Angriffswerkzeug ein Ausgangsunkt für neue und wirkungsvollere Angriffe und damit verbundene ökonomische und gesamtgesellschaftliche Schäden sein. Andererseits kann durch die Nutzung generativer KI der Schutz und die Resilienz von digitalen Systemen substanziell verbessert und Angriffen, auch neuen Angriffsklassen, die durch generative KI automatisiert generiert werden, wirksamer begegnet werden.

Das Papier skizziert sowohl die Risiken als auch insbesondere die Chancen des Einsatzes generativer KI zur Erhöhung der Cybersicherheit. Generative KI könnte in der Fläche zu einer wirksamen Reduktion der klassischen wie auch der neuen Risiken beitragen. Die positiven Potenziale der generativen KI für den Bereich der Cybersicherheit können sich aber nur dann entfalten, wenn die generative KI Vertrauenswürdigkeit („Trustworthy AI“) gewährleistet, das heißt, sie muss robust, privatsphärenerhaltend, transparent, nachvollziehbar und diskriminierungsfrei arbeiten. Ansonsten verwandeln sich vermeintliche Chancen in zusätzliche Risiken.

Die rasante Entwicklung bei generativer KI zeigt, dass die mit sehr hohen Investitionen entwickelten großen, proprietären, generativen Modelle bereits nach sehr kurzer Zeit veraltet sind. Deren Leistungsfähigkeit wird schnell durch neue Modelle, zum Teil mit neuen, ressourceneffizienteren Ansätzen sowie auch durch unabhängige, kostenlose Open-Source-Lösungen übertroffen. Der mit hohen Investitionssummen erzielte Vorsprung der Anbieter generativer KI-Modelle der ersten Stunden erweist sich als flüchtig. Eine nachhaltig wirkende digitale Transformation in Unternehmen und Behörden benötigt deshalb andere Ansätze. Darin liegt eine Chance für Industrie, Forschung und Verwaltung in Deutschland, solche Lösungen bereitzustellen.

Das Papier richtet sich an die Politik und formuliert Empfehlungen, die sowohl dringende Forschungsfragen adressieren als auch auf Umsetzungsthemen eingehen, die teilweise einen Beitrag zur Umsetzung der Anforderungen des EU AI Acts leisten könnten. Dazu gehören Empfehlungen zur Entwicklung und Erprobung von Testverfahren sowie zur Etablierung von vertrauenswürdigen Plattformen, die den sicheren Betrieb KI-basierter Ökosysteme ermöglichen. Wenn Umsetzungsempfehlungen und Referenzimplementierungen schnell bereitgestellt werden, trägt dies zur Rechtssicherheit für KMU, Industrie und den Dienstleistungssektor bei.

Kryptografie ist eine Schlüsseltechnologie für den Schutz in der digitalen Welt. Sie ermöglicht vertrauliche Kommunikation, Onlinebanking, die Geheimhaltung von persönlichen Daten und Geschäftsgeheimnissen, den Nachweis der Echtheit von Dokumenten und Medien, das Einspielen von authentischen Updates und Patches für Betriebssysteme und für Antivirenprogramme, Smart Home Automation, sicheres Cloud Computing, Smart Grids und vieles mehr.

Kryptoagilität bezeichnet die Fähigkeit, kryptografische Verfahren schnell und unkompliziert auszutauschen. Sie gewährleistet die langfristige Sicherheit von kryptografischen Systemen, da kryptoagile Systeme offen für Neuerungen sind und ihre Widerstandsfähigkeit gegenüber Angriffen auf einzelne Verfahren erhöhen.

Jede Sicherheitsarchitektur, die Kryptografie einsetzt, muss Kryptoagilität berücksichtigen. Die Erfahrung zeigt, dass kryptografische Verfahren im Laufe der Zeit, teils sogar disruptiv, geschwächt oder gebrochen werden können und dann schnell durch sicherere Verfahren ersetzt werden müssen. Gleichzeitig werden kryptografische Verfahren ständig verbessert und mit neuen Schutzfunktionen ausgestattet – auch hier ist Kryptoagilität unerlässlich.

Die fortlaufenden Innovationen in der Kryptografie sowie die kontinuierlich wachsenden Bedrohungen erfordern eine stetige Weiterentwicklung und Anpassung kryptografischer Verfahren, was die Notwendigkeit von Kryptoagilität unterstreicht. Kryptoagilität ist daher eine Grundvoraussetzung für Innovationen in der Kryptografie und für die langfristige Sicherstellung von IT-Sicherheit. Sie stärkt die technologische Souveränität und bietet Unternehmen durch ihre kluge Umsetzung Wettbewerbsvorteile.

Das Impulspapier „Kryptoagilität“ gibt einen Überblick über den aktuellen Stand kryptoagiler Systeme, identifiziert zentrale Forschungsfragen und zeigt die Herausforderungen und notwendigen Handlungsfelder für die Umsetzung auf. Abschließend werden Empfehlungen für die Berücksichtigung, Implementierung und Weiterentwicklung von Kryptoagilität in Politik, Wirtschaft und Gesellschaft gegeben.

Quantencomputing ermöglicht nicht nur viele wichtige Anwendungen, sondern bedroht auch die kryptografischen Verfahren, die heute die Grundlage für Cybersicherheit bilden. Dieses Impulspapier gibt erst einen Überblick über die wichtigsten Quantenalgorithmen und den derzeitigen Stand der Quantencomputerhardware, um darauf aufbauend das Gefährdungspotenzial für die aktuell verwendeten kryptografischen Verfahren zu beschreiben.

Die Post-Quanten-Kryptografie sowie die Kryptoagilität werden als wichtige Schutzmaßnahmen gegen Angriffe, die durch Quantencomputer möglich werden (Quantenangriffe), herausgestellt und die Notwendigkeit einer sehr zügigen Migration zu den neuen Verfahren wird betont.

Unter aktiver Cyberabwehr werden eine Reihe von Technologien und Maßnahmen verstanden, die Behörden der Gefahrenabwehr und der Strafverfolgung dabei unterstützen können, Straftaten im Cyberraum abzumildern, zu verhindern oder zu verfolgen.

Das Impulspapier diskutiert vier Klassen solcher Maßnahmen: I) Manipulation des Internetverkehrs, II) Abkoppeln oder Übernehmen von für Angriffe genutzten Netzwerkressourcen, III) Beseitigung von Schwachstellen und Schadsoftware auf den Systemen der Opfer, IV) Eingriffe in für Angriffe genutzte Systeme. Für alle vier Klassen werden Beispiele für konkrete Maßnahmen gegeben.

Aktive Cyberabwehr wird in der Öffentlichkeit häufig mit Hackbacks gleichgesetzt. Unter einem Hackback versteht man allerdings sehr allgemein einen digitalen Gegenangriff, der auch rein auf Rache und Vergeltung angelegt sein kann. Hackbacks in dieser Allgemeinheit werden deshalb von Politik und Wissenschaft nahezu einhellig abgelehnt. Bedauerlicherweise führt die fälschliche Gleichsetzung von aktiver Cyberabwehr und Hackbacks aber dazu, dass auch aktive Cyberabwehr oft pauschal abgelehnt wird. Ein Ziel dieses Impulspapiers ist deshalb, zur Versachlichung der Diskussion zur aktiven Cyberabwehr beizutragen.

Sichere digitale Identitäten sind wichtige Treiber der Modernisierung der öffentlichen Verwaltung, aber auch der Digitalisierung in Unternehmen. Systeme für den elektronischen Identitätsnachweis (eID) sind Lösungen zur Umsetzung eines digitalen Abbilds für die Anwendung im staatlichen oder privatwirtschaftlichen Umfeld.

Derzeit dominieren im privatwirtschaftlichen Bereich die bekannten Anbieter, wie Facebook, Google oder Apple. Diese stellen Bürgerinnen und Bürgern zwar komfortable, einfach zu nutzende Dienste bereit, bieten ihnen jedoch kaum Möglichkeiten, selbstbestimmt zu entscheiden, welche Identifizierungsdaten für welche Dienste genutzt und welche Daten wo gespeichert werden dürfen. Zudem ist das Sicherheitsniveau der Lösungen sehr unterschiedlich; nicht jedes Angebot ist für jeden Onlinedienst oder jede digitale Anwendung geeignet. Ein hohes Sicherheitsniveau bietet die eID-Funktion des elektronischen Personalausweises, der aber noch nicht in der Breite eingesetzt wird.

Lösungen zu selbstbestimmten Identitäten – Self-Sovereign Identities (SSI) – ermöglichen es Bürgerinnen und Bürgern, selbst zu entscheiden, welche Form der digitalen Identität sie gegenüber einem Dienstanbieter nutzen, sei es ein Pseudonym, eine hoheitlich bestätigte Identität oder eine an spezielle Attribute gebundene Identität, wie zum Beispiel den Arbeitgeber. Ein Manko existierender SSI-Ansätze ist, dass sie meist nicht nutzungsfreundlich sind und das Prinzip der Datensparsamkeit missachten. Es gibt derzeit viele Angebote am Markt, die alle jeweils Vor- und Nachteile haben. Eine One-Fits-All-Lösung wird es nicht geben und sollte auch nicht angestrebt werden. Jedoch erschwert der derzeit existierende, stark fragmentierte Markt an eID-/SSI-Lösungen eine breit akzeptierte, nutzungsfreundliche, aber gleichzeitig sichere und selbstbestimmte Verwendung digitaler Identitäten. Dies führt zu Verzögerungen, auch bei der Umsetzung von Onlinediensten in der öffentlichen Verwaltung. Durch gezieltes politisches Handeln kann und sollte hier Abhilfe geschaffen werden. So sollte durch das Setzen eines politischen Rahmens darauf hingewirkt werden, dass die Marktteilnehmerinnen und Marktteilnehmer in den Wettbewerb treten können, wobei ihre Angebote an den Nutzerinnen und Nutzern orientiert sind und gleichzeitig die demokratischen Werte der Sicherheit, des Vertrauens und der Selbstbestimmtheit gewährleisten.

Im Dezember 2019 hat die Wissenschaftliche Arbeitsgruppe des Nationalen Cyber-Sicherheitsrats ein Positionspapier zur technologischen Souveränität und deren Bedeutung für die Cybersicherheit in Deutschland und Europa veröffentlicht. Die Entwicklungen in wichtigen Schlüsseltechnologien, aber insbesondere auch die aktuelle geopolitische Lage verdeutlichen die Dringlichkeit des politischen Handelns. Das vorliegende Papier greift deshalb die wichtigsten Empfehlungen des Positionspapiers von 2019 auf und schärft sie nach, soweit dies durch die geänderte Lage geboten erscheint. Bei der Erstellung des Papiers 2019 standen Maßnahmenempfehlungen im Mittelpunkt, um insbesondere mittel- bis langfristig „vor die Lage zu kommen“. Die Empfehlungen sollten Unternehmen, staatliche Institutionen sowie Betreiber kritischer Infrastrukturen darin unterstützen, sich effektiv und nachhaltig vor Cyberattacken zu schützen, die darauf abzielen, zu manipulieren oder Abläufe zu stören.

Das ist die Voraussetzung, um europäische Werte wie Freiheit, Fairness und Offenheit nachhaltig zu gewährleisten. Durch die aktuellen geopolitischen Entwicklungen und die erforderliche Reaktion auf einen Angriffskrieg, der auf europäischem Boden geführt wird, müssen nun vermehrt Risiken durch gezielte, staatlich gelenkte Cyberangriffe auf kritische Infrastrukturen und auf Unternehmen in Schlüsselbereichen, aber auch Fragen der gezielten Desinformation betrachtet werden. Die Frage der Resilienz von Unternehmen und Infrastrukturen in nationalen und europäischen Schlüsselbereichen gegen solche gezielten Cyberangriffe wird derzeit stark diskutiert. Die Empfehlungen im Positionspapier von 2019 haben diese relevanten Fragestellungen bereits deutlich und mit hoher Priorität adressiert. Die aktuellen Entwicklungen haben die Dringlichkeit des Handelns leider bestätigt. Um diese Handlungsdringlichkeit noch einmal zu unterstreichen, fassen wir nachfolgend die wichtigsten Empfehlungen und ihre Bedeutung in Bezug auf das Ziel der Erhöhung der Cyberresilienz noch einmal pointiert zusammen.

Die Cybersicherheit in Deutschland wird nicht nur durch außereuropäische Nachrichtendienste bedroht, sondern auch durch ausländische Unternehmen, die durch gesetzliche Vorgaben gezwungen sind, die Nachrichtendienste ihres Herkunftsstaates zu unterstützen. Um sich gegen diese Bedrohung zu wehren, ist es notwendig, die technologische und wirtschaftliche Abhängigkeit zu verringern und digitale Souveränität zu stärken. Das vorliegende Impulspapier untersucht, mit welchen Zielsetzungen und Mitteln ausländische Nachrichtendienste − direkt oder über in Deutschland operierende Unternehmen − auf die Cybersicherheit in Deutschland Einfluss nehmen könnten. Hierzu werden die jeweiligen Rechtsgrundlagen und rechtlichen Handlungsmöglichkeiten analysiert, auf deren Grundlage die Geheimdienste agieren.

Den Nachrichtendiensten der USA, Russlands und Chinas kommt mit ihren Zielsetzungen und Möglichkeiten in der derzeitigen politischen Weltlage die größte Bedeutung zu. Diese drei Staaten unterhalten die drei weltweit größten nachrichtendienstlichen Infrastrukturen. Daher werden deren Rechtsgrundlagen für Auslandsaufklärung und Cyberspionage, soweit dies auch Deutschland betreffen kann, näher vorgestellt. Zu diesem Zweck werden für alle drei Staaten die gesetzlichen Aufgaben und Befugnisse der Nachrichtendienste analysiert sowie ihre Möglichkeiten, Staatsangehörige und Unternehmen zu ihrer Unterstützung zu verpflichten. Dabei beschränkt sich die folgende Analyse auf die Rechtslage in den drei Staaten und stellt keine Spekulationen an, wie die Nachrichtendienste ihre gesetzlichen Aufgaben in der Praxis erfüllen und von ihren Befugnissen Gebrauch machen.

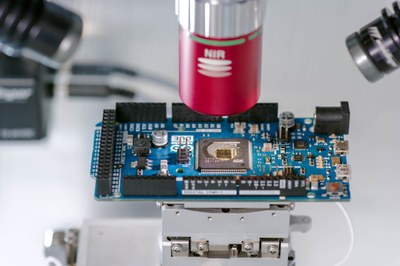

Ziel dieses Impulspapiers ist es, Sicherheitsrisiken, die sich durch das Internet der Dinge (Internet of Things, IoT) ergeben, zu diskutieren und Handlungsempfehlungen zum Umgang mit diesen Risiken zu geben. IoT-Geräte sind meist kleine, vergleichsweise leistungsschwache, vernetzte Geräte, welche in allen Lebens- und Produktionsbereichen zu finden sind. Besonders an IoT-Geräten ist, dass sie aufgrund ihrer Allgegenwärtigkeit und Vernetzung nicht nur selbst Angriffen ausgesetzt sind, sondern auch Dritte gefährden können. Ein wesentliches Sicherheitsrisiko ist eine Massenüberwachung der Anwenderinnen und Anwender durch den massenhaften Missbrauch der durch die IoT-Geräte erhobenen Daten. IoT-Geräte können auch ein Einfallstor in das interne Netzwerk darstellen und dieses so gefährden. Fremde Netze können gefährdet werden, wenn IoT-Geräte für verteilte Überlastangriffe (DDoS-Angriff) missbraucht werden. Letztlich können sogar physische Schäden verursacht werden, wenn IoT-Geräte Aktuatoren steuern. Aufgrund dieser vielfältigen Risiken müssen IoT-Geräte besonders gut abgesichert werden. Jedoch unterliegen diese meist sehr kleinen und vergleichsweise günstigen Geräte einem enormen Kostendruck und sehr kurzen Time-to-Market Zyklen, was dazu führt, dass Sicherheit als zunächst unsichtbare Eigenschaft vernachlässigt wird; es kommt zu einem Marktversagen. Da das IoT eine große Chance für wichtige deutsche Industrien wie dem Maschinenbau oder der Haushaltsgeräteindustrie darstellt, ist es auch aus volkswirtschaftlicher Sicht wichtig, dass starke Sicherheitsmechanismen zur Verfügung stehen. Um diese zu erreichen, müssen zunächst Sicherheitsstandards etabliert werden und es bedarf der gezielten Förderung von Sicherheitsforschung für IoT. Diese Förderung muss zum einen gezielt die Besonderheiten von IoT berücksichtigen, auf der anderen Seite jedoch auch für Rechtssicherheit bei Sicherheitsforschung, insbesondere außerhalb von Academia sicherstellen.

Jedem der Abschnitte sind Handlungsempfehlungen an Politik, Behörden, Unternehmen und Wissenschaft nachgestellt, die dazu beitragen können, dass Sicherheit und maschinelles Lernen aufeinander abgestimmt umgesetzt werden können. Die Politik sollte Anreize schaffen, die Chancen durch maschinelles Lernen nicht ohne eine umfassende Betrachtung der Sicherheitsaspekte zu realisieren. Parallel dazu sollten Unternehmen frühzeitig erkennen, welche Risiken beim Einsatz von maschinellem Lernen entstehen können und wie diesen entgegengewirkt werden kann. Diese Prozesse sollten Behörden durch geeignete Rahmenbedingungen und beispielhafte Umsetzungen unterstützen. Der Wissenschaft fällt die Aufgabe zu, bei der rasanten Entwicklung des maschinellen Lernens nicht die Sicherheitsaspekte aus den Augen zu verlieren und frühzeitig über Gefahren, Schwächen und Gegenmaßnahmen zu informieren.

Die fortschreitende Digitalisierung aller Lebensbereiche erhöht das Risiko einer wachsenden technologischen Abhängigkeit. Die technologische Souveränität, also die Fähigkeit, selbstbestimmt und unabhängig agieren zu können, ist dadurch massiv gefährdet. Jedoch ist es ökonomisch nicht leistbar, alle erforderlichen Informations- und Kommunikationstechnologien (IKT) in Deutschland oder in der EU selber zu entwickeln. Deutschland wird weiterhin auf nicht-europäische IKT-Produkte und -Dienstleistungen angewiesen bleiben. Das Ziel muss es deshalb sein, durch ein abgestimmtes Maßnahmenbündel, das zentrale Technologiefelder abdeckt, die technologische Souveränität zu erhöhen und damit auch ein hohes Maß an Cybersicherheit zu erreichen. Erforderlich sind folgende Maßnahmen:

Gezielte Desinformation gefährdet zunehmend die demokratische Willensbildung und bedarf daher gesteigerter Aufmerksamkeit und gezielter Gegenmaßnahmen.

Desinformation wird vor allem über das Internet und insbesondere Social Networks als Text- oder Bildnachricht verbreitet. Künftig ist verstärkt mit manipulierten Bild- und Tonaufnahmen („Deep Fakes“) zu rechnen, die durch ihre sinnliche Nachvollziehbarkeit besonders glaubwürdig wirken. Desinformation verfolgt das Ziel, politische Gegner in der öffentlichen Wahrnehmung zu diskreditieren, Stimmung für oder gegen bestimmte Gruppen zu erzeugen und so die öffentliche Meinungsbildung zu beeinflussen. Entscheidend für digitale Desinformation ist, dass jeder sie erzeugen und einfach, kostengünstig und anonym verbreiten kann. Oft findet die Verbreitung auch durch professionelle „Trolle“ oder gar „Trollarmeen“ sowie Social Bots statt, die als Computerprogramme in Social Networks menschliche Nutzer imitieren.

In ihrer Wirkung untergräbt Desinformation das Vertrauen in Institutionen oder Personen, unterstützt Verschwörungstheorien und fördert eine grundsätzliche politische Lagerbildung. Sie erzeugt Unsicherheit darüber, auf welche Wahrheit man sich in der politischen Kommunikation vernünftigerweise einigen kann. Individuell bleibt die falsche Information besser im Gedächtnis als eine nachträglich korrigierte. Social Bots können vermeintliche Mehrheitsverhältnisse vortäuschen und so durch die „Schweigespirale“ das öffentliche Meinungsklima beeinflussen.

Gegenmaßnahmen können auf technischer Ebene wirksam nur die Betreiber von Social Networks ergreifen. Sie können auf Beschwerden schnell reagieren und Inhalte oder Accounts sperren oder löschen. Automatisierte Verfahren werden immer besser, werden aber nie vollständig zuverlässig sein. Auf rechtlicher Ebene sind bei Straftaten Gegenmaßnahmen möglich. Die Betreiber sind hierzu durch das Netzwerkdurchsetzungsgesetz auch verpflichtet. Jenseits des Strafrechts sind alle Regulierungsmaßnahmen aber an der von Artikel 5 Absatz 1 des Grundgesetzes geschützten Meinungsfreiheit zu messen, die nur inhaltsneutrale Maßnahmen erlaubt.

Politische Gegenmaßnahmen helfen, den notwendigen Meinungskampf zu unterstützen: Bezogen auf Social Networks ist der geltende zivil- und strafrechtliche Rechtsrahmen besser durchzusetzen. Sie sollten auch anders formulierte, aber inhaltsgleiche Inhalte entfernen müssen. Soweit sie automatisierte Verfahren einsetzen, sollten sie ihre Eingreifkriterien veröffentlichen. Strafbare Inhalte sollten sie anzeigen und ihre Autoren aufdecken müssen. Für Social Bots sind Kennzeichnungspflichten vorzusehen. Zum Schutz der Meinungsfreiheit sollten sie ein wirksames und schnelles Beschwerdeverfahren für zu Unrecht gesperrte oder gelöschte Inhalte vorsehen.

Es sind technische und interdisziplinäre Forschungsprojekte zu fördern, die die Erkenntnisse verschiedener Disziplinen (wie Technik, Journalistik, Psychologie, Recht) zusammenbringen, um gesamthaft wirksame und umsetzbare Lösungen zu entwickeln. Zu erforschen ist, wie – auch mit Künstlicher Intelligenz – Desinformation, Deep Fakes, Malicious Social Bots und ihre Verbreitungswege erkannt, gekennzeichnet, gesperrt und gelöscht werden können. Zu untersuchen sind Charakteristika von Desinformation und ihre Wirkungen auf Einzelne und die Gesellschaft sowie politische und rechtliche Gegenmaßnahmen, die eine wirksame Bekämpfung bewirken, ohne Meinungsfreiheit zu behindern. Für diese Forschung sollten Social Networks (zu diesem Zweck geschützt) ausreichende Mengen an – anonymisierten oder pseudonymisierten – Kommunikationsdaten zur Verfügung stellen (müssen).